IA de alto rendimiento: vLLM y Qwen VLM en producción

El despliegue de una ia de alto rendimiento requiere el dominio de herramientas de orquestación de inferencia como vLLM, que utiliza PagedAttention para maximizar el rendimiento. En este curso, se aborda la integración de modelos multimodales avanzados como Qwen VLM, permitiendo que los sistemas no solo procesen texto, sino que comprendan información visual con alta precisión. Por lo tanto, el enfoque principal es eliminar los cuellos de botella en la memoria de video y reducir el tiempo de respuesta en entornos productivos. El objetivo es alcanzar una eficiencia técnica que permita escalar soluciones de IA minimizando los costes de computación.

IA de alto rendimiento (vLLM & Qwen VLM)

Arquitectura de una ia de alto rendimiento

En primer lugar, comprender el funcionamiento de vLLM es esencial para cualquier arquitecto de sistemas modernos. Los alumnos aprenden a gestionar la memoria KV-Cache para permitir un flujo de tokens constante y sin latencia excesiva. Por este motivo, el contenido detalla la configuración de motores de inferencia para ia de alto rendimiento utilizando arquitecturas de atención optimizadas. Asimismo, se explora el despliegue de Qwen VLM para tareas de comprensión de imágenes y documentos complejos. Además de esto, se explica cómo la cuantización de modelos (AWQ o GPTQ) permite ejecutar modelos masivos en hardware más accesible. En consecuencia, se democratiza el acceso a capacidades de visión artificial de última generación. Por otra parte, se estudian los benchmarks de rendimiento para comparar diferentes backends de ejecución. De igual importancia es el aprendizaje sobre el servicio de APIs compatibles con OpenAI para facilitar la integración. En definitiva, el uso de estas tecnologías asegura un despliegue de IA robusto y escalable.

Aplicación práctica y escenarios reales

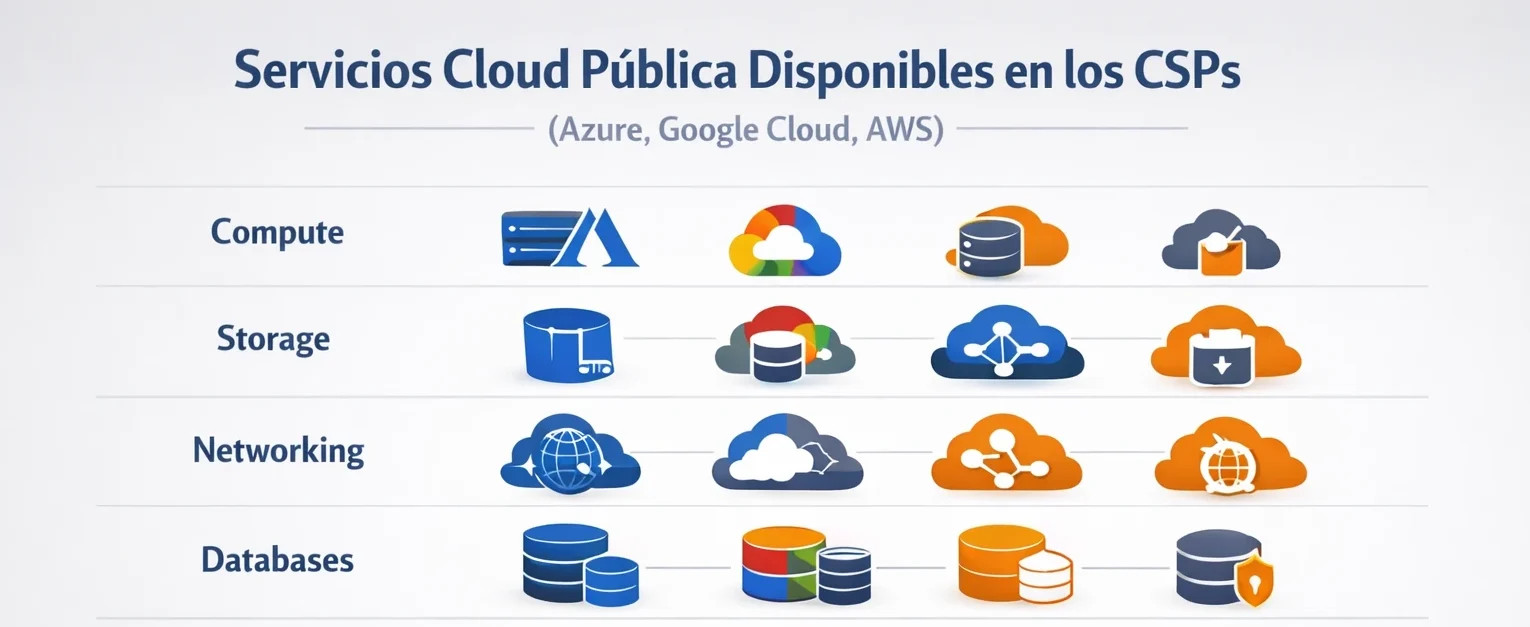

En cuanto a la implementación técnica, los participantes resolverán casos de optimización de throughput mediante el batching continuo de vLLM. Deberán diseñar flujos de trabajo donde Qwen VLM procese feeds de video en tiempo real para la extracción de metadatos. Por lo tanto, se practican dinámicas de ajuste de parámetros de inferencia para equilibrar precisión y velocidad. Los alumnos configuran contenedores Docker optimizados para GPU con drivers NVIDIA específicos para aceleración de ia de alto rendimiento. Adicionalmente, los escenarios incluyen la creación de sistemas de RAG multimodal donde la imagen aporta contexto crítico a la respuesta del modelo. Por otro lado, el curso ofrece soluciones para la monitorización de latencia y uso de VRAM en producción. Asimismo, se exploran técnicas de despliegue en nubes públicas como AWS o Google Cloud utilizando instancias aceleradas. En relación con la escalabilidad, se abordan casos de balanceo de carga entre múltiples nodos GPU. Por último, cada taller refuerza la capacidad de evaluar críticamente el coste por token de cada arquitectura. Así se garantiza que la solución sea técnica y económicamente viable.

Conclusión sobre la ia de alto rendimiento

En resumen, este programa técnico sitúa al profesional en la vanguardia del despliegue de modelos generativos. Al finalizar el curso, el estudiante dominará la infraestructura necesaria para sostener una ia de alto rendimiento bajo condiciones de alta demanda. Podrá implementar asistentes visuales y conversacionales que superen las limitaciones de los métodos tradicionales de inferencia. Debido a la rápida evolución de los modelos Qwen y las herramientas de servicio, estos conocimientos son vitales para mantener la competitividad tecnológica. Por consiguiente, se logra un equilibrio entre la potencia bruta de los modelos y la eficiencia operativa. En conclusión, la maestría en vLLM y Qwen VLM es el estándar de oro para la ingeniería de IA actual.

¿Eres docente?

¿Quieres saber más?

¿Qué se aprenderá?

Objetivos del curso

- Entender los cuellos de botella de la inferencia y cómo optimizarlos con vLLM (gestión de memoria y batching).

- Desplegar un servidor de inferencia y exponerlo como API compatible con OpenAI.

- Trabajar con modelos multimodales (VLM) para análisis de imágenes y documentos.

- Aplicar cuantización para ejecutar modelos grandes en GPUs moderadas (enfoque práctico).

- Integrar el modelo en scripts y aplicaciones (consumo por API).

- Construir un flujo de agente: entrada (imagen) → análisis VLM → decisión → acción (JSON).

¿Por qué este curso?

Una formación con impacto real y medible

Explora nuestro catálogo de cursos diseñados para profesionales y empresas que buscan dominar las tecnologías más demandadas.

Cifras de éxito

"Este curso nos ha ayudado a tener éxito en nuestro sector."

Testimonios

Contenidos

Temario

A continuación detallamos todos los módulos impartidos en este curso. Si tiene alguna duda o no aparece, contacte con nosotros.

- Módulo 1Arquitectura de Inferencia y Aceleración

- Módulo 2Modelos Multimodales (VLM) con Qwen2-VL

- Módulo 3Resto de módulos

Arquitectura de Inferencia y Aceleración

6 horas

Optimización de latencia y VRAM mediante vLLM y el concepto de PagedAttention. Implementación de batching continuo para gestionar múltiples usuarios y despliegue práctico de servidores de inferencia en entornos GPU (T4).

Modelos Multimodales (VLM) con Qwen2-VL

8 horas

Integración de vision encoders con LLMs para tareas de OCR, descripción de escenas y extracción de datos. Aplicación de cuantización (AWQ/FP8) para ejecutar modelos de gran escala en hardware de consumo y análisis técnico de documentos complejos.

Resto de módulos

Resto de horas

Si quiere conocer el resto de módulos, contacte con nosotros.

Metodología

Aprendizaje basado en la práctica

Cada módulo combina teoría y ejercicios aplicados

Implementación técnica centrada en el rendimiento de inferencia, cuantización de modelos y despliegue escalable en infraestructuras GPU.

Público objetivo

Formación para profesionales actuales

Enfocado a quienes buscan dominar herramientas tecnológicas modernas

Ingenieros de Machine Learning, desarrolladores de IA y arquitectos de soluciones que buscan maximizar el rendimiento de modelos de lenguaje y visión.

FAQ

Resolvemos tus dudas sobre la formación

Aclaramos las dudas más comunes sobre el curso, desde los requisitos previos hasta la metodología y el soporte disponible, para asegurarte de que estés completamente preparado para aprovechar al máximo esta formación.

Otros cursos

Cursos especializados para impulsar tu negocio

Explora nuestro catálogo de cursos diseñados para profesionales y empresas que buscan dominar las tecnologías más demandadas.